11/07/2025

En la era digital actual, la interacción con la tecnología va más allá de la pantalla y el teclado. Los sistemas de voz se han vuelto omnipresentes, desde asistentes virtuales en nuestros teléfonos hasta los anuncios automáticos que escuchamos en aeropuertos y centros de llamadas. Pero, ¿alguna vez te has preguntado cómo funcionan estas maravillas de la ingeniería del sonido? ¿O cómo puedes empezar a construir tu propio sistema de voz? Este artículo te guiará a través de los fundamentos, desde la instalación de librerías esenciales hasta la comprensión profunda de cómo el texto se transforma en palabras habladas.

Imagina un escenario común: estás en un aeropuerto, a punto de aterrizar, y una avalancha de anuncios de conexión inunda la cabina. "Si su destino es Tallin, busque la puerta 123"; "Para el vuelo XYZ a San Petersburgo, diríjase a la puerta 234". Los tripulantes de cabina no pueden hablar una docena de idiomas, y la calidad del sonido en los sistemas de megafonía, sumado al ruido ambiente, dificulta la comprensión. ¿Qué pasaría si pudieras seleccionar el idioma de los anuncios y un sistema informático a bordo generara esos mensajes dinámicamente, en tiempo real, sin necesidad de grabaciones previas? Aquí es donde entra en juego la síntesis de texto a voz (TTS), una tecnología madura y fundamental para la interacción hombre-máquina moderna.

- Instalando SpeechRecognition: Tu Primer Paso

- El Fascinante Mundo de la Síntesis de Texto a Voz (TTS)

- La Anatomía de la Voz: ¿Cómo Funciona un Sistema TTS Internamente?

- La Revolución de la Inteligencia Artificial: Redes Neuronales en TTS

- Manipulando la Voz: Implementación y Control Avanzado

- Más Allá de Tu Computadora: Soluciones en la Nube y Multiplataforma

- Preguntas Frecuentes sobre Sistemas de Voz

Instalando SpeechRecognition: Tu Primer Paso

Antes de sumergirnos en la complejidad de la síntesis de voz, es crucial entender que la interacción con la voz a menudo implica dos componentes clave: el reconocimiento de voz (transformar el habla en texto) y la síntesis de voz (transformar el texto en habla). Para el reconocimiento de voz en Python, una de las librerías más accesibles y potentes es SpeechRecognition. Su instalación es sorprendentemente sencilla y te permitirá empezar a experimentar rápidamente.

Para instalar la librería SpeechRecognition en tu entorno de desarrollo, simplemente necesitas abrir la terminal de comandos de tu sistema operativo (como el Símbolo del sistema en Windows, la Terminal en macOS o la línea de comandos en Linux) y ejecutar el siguiente comando:

pip install SpeechRecognitionEste comando utiliza pip, el gestor de paquetes de Python, para descargar e instalar automáticamente la librería y sus dependencias. Una vez completado, estarás listo para empezar a trabajar en programas que puedan entender la voz humana.

El Fascinante Mundo de la Síntesis de Texto a Voz (TTS)

La síntesis de texto a voz (TTS) es la tecnología que permite a una computadora generar voz humana a partir de texto escrito. Aunque hoy la damos por sentada en asistentes de voz, GPS y sistemas de lectura de pantalla, su desarrollo ha sido un viaje largo y complejo. Los primeros intentos, hace décadas, a menudo resultaban en voces robóticas y poco naturales. ¿Recuerdas la famosa frase de Stephen Hawking: "All we need to do is to make sure we keep talking"? Esa voz icónica fue generada por un sintetizador portátil de voz de los años 90, un testimonio de los avances tempranos en esta área.

Los sistemas TTS están muy extendidos porque resuelven un problema fundamental: la necesidad de mensajes dinámicos que no pueden ser pregrabados. Imagina la cantidad de memoria que necesitaríamos para almacenar cada posible anuncio de conexión en un aeropuerto en todos los idiomas. La TTS permite crear mensajes 'sobre la marcha', de forma eficiente y flexible.

La Anatomía de la Voz: ¿Cómo Funciona un Sistema TTS Internamente?

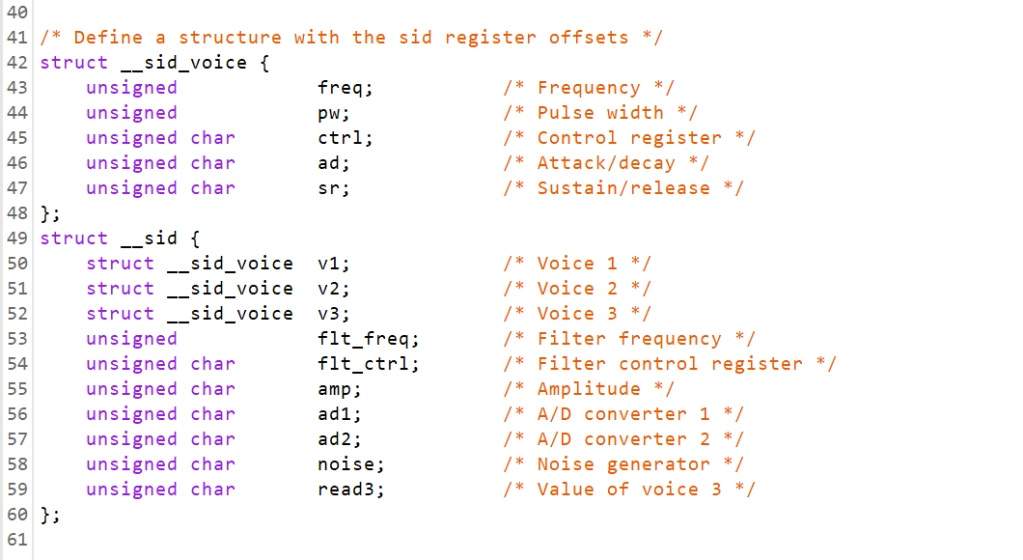

Para lograr una voz que suene natural, los motores TTS modernos emplean un proceso sofisticado que se puede dividir en varias fases. Históricamente, se intentó crear voz a través de reglas de pronunciación, pero la complejidad y las excepciones de los idiomas naturales hacían que estas voces sonaran "automáticas" y poco fluidas.

1. Análisis de Texto: La Comprensión Inicial

El primer paso es el análisis del texto de entrada. Los analizadores de texto son mucho más complejos que los que se usan en lenguajes de programación. Deben:

- Tokenización: Identificar límites de palabras y frases.

- Corrección de errores: Detectar y corregir errores tipográficos.

- Categorías gramaticales: Asignar etiquetas como sustantivo, verbo, adjetivo.

- Análisis de puntuación: Interpretar comas, puntos, signos de interrogación para pausas y entonación.

- Descodificación: Entender abreviaturas ("Dr.", "Sr."), contracciones y símbolos especiales ("$", "@").

- Resolución de ambigüedades: Determinar el significado y pronunciación correcta de palabras homógrafas (ej. "project" como sustantivo o verbo, que cambia el acento).

Estos analizadores a menudo son específicos para idiomas y regiones, e incluso para dominios particulares como números, fechas o URLs. La salida de esta fase es una estructura interna que describe las palabras con metadatos como su categoría gramatical, pronunciación y acento.

2. Generación de Pronunciación: Del Texto al Sonido

Una vez analizado el texto, el sistema debe generar la forma fonética de cada palabra, transformando "school" en sus símbolos de sonido correspondientes. Para idiomas con una correspondencia más directa entre grafema y fonema (como el español), se pueden aplicar reglas relativamente sencillas. Sin embargo, para idiomas como el inglés, donde la pronunciación difiere significativamente de la escritura, se utilizan métodos estadísticos y bases de datos de palabras conocidas. Además, la pronunciación de una palabra puede cambiar ligeramente cuando se combina con otras en una oración, requiriendo un procesamiento posterior al léxico.

3. El Desafío de la Prosodia: Entonación y Emoción

Uno de los aspectos más difíciles de replicar en la síntesis de voz es la prosodia, que incluye la entonación, el ritmo, el énfasis y las pausas que usamos al hablar para transmitir significado y emoción. El texto escrito, por sí solo, no proporciona suficientes símbolos para expresar toda la riqueza prosódica. Aunque los signos de puntuación dan algunas pistas (una coma para una pausa breve, un signo de interrogación para una entonación ascendente), la lectura real es mucho más matizada.

Dos personas pueden leer el mismo texto de manera muy diferente. Resolver el problema de la prosodia de forma totalmente automática sigue siendo un reto, a pesar de la intensa investigación. Es por eso que los desarrolladores a menudo recurren a lenguajes de marcado como SSML (Speech Synthesis Markup Language) para añadir control explícito sobre la prosodia.

La Revolución de la Inteligencia Artificial: Redes Neuronales en TTS

Los métodos de Machine Learning y las redes neuronales han transformado radicalmente el campo de la síntesis de voz. En lugar de depender de reglas o concatenar fragmentos pregrabados, los sistemas basados en redes neuronales pueden generar voz de forma generativa, es decir, 'crean' el sonido desde cero.

Estos modelos, a menudo entrenados con vastas cantidades de grabaciones de voz natural, aprenden a predecir la siguiente muestra de audio en una secuencia. El resultado es una voz que conserva todas las características del habla humana, incluyendo la respiración, la acentuación y, crucialmente, la entonación natural. Esto significa que las redes neuronales pueden abordar de manera más efectiva el complejo problema de la prosodia, produciendo voces que suenan notablemente humanas y expresivas.

Las ventajas de estos sistemas generativos incluyen una menor superficie de memoria (no necesitan almacenar enormes bases de datos de grabaciones) y una mayor flexibilidad para ajustar parámetros como el tono, crear voces completamente nuevas o incluso imitar el canto. Gigantes tecnológicos como Microsoft están a la vanguardia, ofreciendo servicios de TTS basados en redes neuronales que proporcionan voces de alta calidad con un rendimiento casi instantáneo.

Manipulando la Voz: Implementación y Control Avanzado

Aunque el artículo original se centra en .NET, los principios de manipulación de la voz son universales. Las APIs de síntesis de voz modernas ofrecen un control detallado sobre cómo se genera el habla. Esto incluye:

- Selección de voces: Elegir entre diferentes voces instaladas (masculinas, femeninas, de distintas edades) y, lo que es más importante, voces en diferentes idiomas.

- Control de salida: Dirigir la voz a un dispositivo de audio predeterminado, a un archivo de audio para guardarla, o a un flujo de datos.

- Ajustes de parámetros: Modificar el volumen, la velocidad de habla y la entonación. También es posible pausar y reanudar la síntesis, y recibir eventos para sincronizar otras acciones.

- Gestión de idiomas: Para poder usar voces en otros idiomas, a menudo es necesario instalar paquetes de idioma adicionales en el sistema operativo. Por ejemplo, en Windows, esto se hace a través de la configuración de "Hora e idioma".

Usando SSML para una Voz Estructurada

Para un control aún más preciso sobre la síntesis, se utiliza el Lenguaje de Marcado de Síntesis de Voz (SSML). SSML es una recomendación multiplataforma del W3C que permite a los desarrolladores añadir etiquetas al texto para especificar cómo debe ser leído. Por ejemplo, puedes indicar pausas, cambiar la entonación, especificar cómo se leen números (como ordinal o cardinal), o incluso cambiar de voz o idioma en medio de una frase. Esto es invaluable para crear experiencias de voz ricas y personalizadas.

| Enfoque TTS | Descripción | Pros | Contras |

|---|---|---|---|

| Basado en Reglas | Genera voz aplicando reglas lingüísticas de pronunciación. | Muy compacto en memoria. | Voz robótica, poco natural; dificultad con excepciones. |

| Concatenación (Selección de Unidad) | Une fragmentos de voz pregrabados (unidades) de una gran base de datos. | Voz más natural y fluida que las basadas en reglas. | Requiere grandes bases de datos; menos flexible para ajustar la prosodia sin grabaciones adicionales. |

| Redes Neuronales (Generativo) | Modelos de IA que aprenden a generar voz desde cero a partir de texto. | Voz extremadamente natural, expresiva y con prosodia realista; alta flexibilidad; menor tamaño de modelo. | Requiere gran poder computacional para el entrenamiento; tecnología más reciente y compleja. |

Más Allá de Tu Computadora: Soluciones en la Nube y Multiplataforma

Si bien muchas plataformas ofrecen APIs nativas para la síntesis de voz (como NSSpeechSynthesizer en macOS o eSpeak en Linux), las soluciones basadas en la nube han ganado una enorme popularidad. Proveedores como Microsoft Azure, Google Cloud y Amazon Web Services ofrecen potentes servicios de texto a voz que no solo proporcionan una amplia gama de voces y idiomas (Microsoft ofrece más de 75 voces en 45 idiomas), sino que también permiten la creación de voces personalizadas.

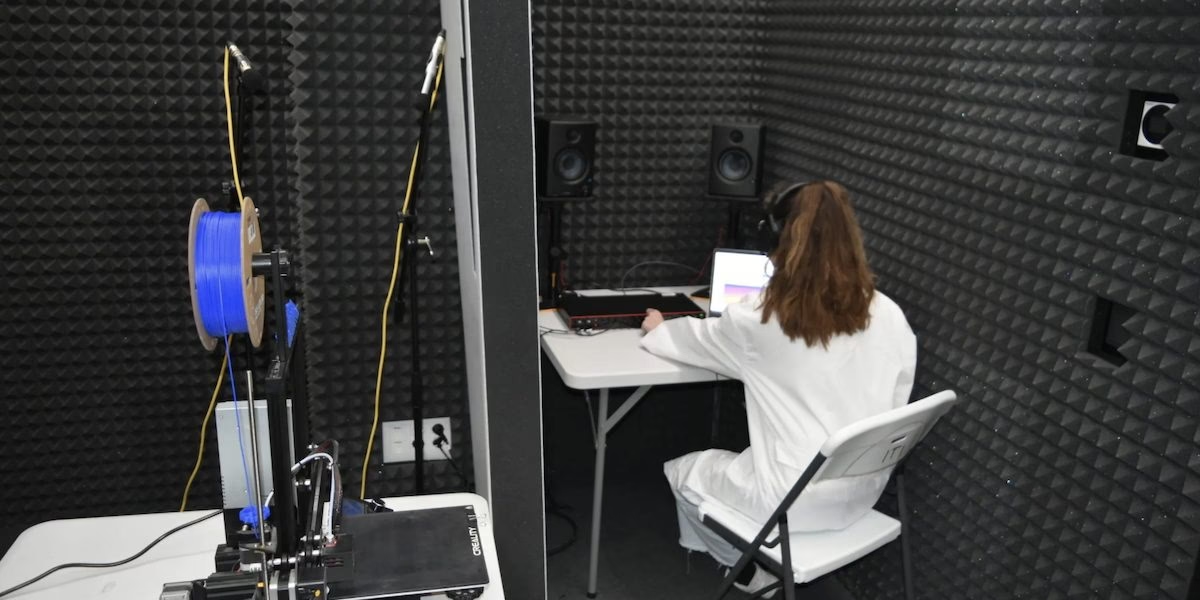

La creación de una voz personalizada implica entrenar un modelo de Machine Learning con archivos de audio de alta calidad y sus transcripciones. Esto abre la puerta a marcas y empresas que desean una voz única y reconocible para sus productos y servicios. Estos servicios en la nube son accesibles a través de SDKs (Kits de Desarrollo de Software) que soportan múltiples lenguajes de programación y plataformas, lo que facilita su integración en casi cualquier aplicación.

Preguntas Frecuentes sobre Sistemas de Voz

¿Qué es la síntesis de texto a voz (TTS)?

La síntesis de texto a voz es una tecnología que convierte texto escrito en habla audible, permitiendo que las computadoras 'lean' en voz alta. Es fundamental para lectores de pantalla, asistentes virtuales, y sistemas de anuncios automáticos.

¿Qué es el reconocimiento de voz?

El reconocimiento de voz es el proceso inverso a la síntesis de voz. Transforma el habla humana en texto escrito. Es la tecnología detrás de los sistemas de dictado y los comandos de voz que usamos en nuestros dispositivos.

¿Puedo cambiar la voz de mi sistema TTS?

Sí, la mayoría de los sistemas TTS permiten seleccionar entre varias voces (masculinas, femeninas, de diferentes idiomas y acentos) y ajustar parámetros como el volumen y la velocidad. Las APIs modernas, como las de servicios en la nube, ofrecen una gran variedad y flexibilidad.

¿Es difícil instalar SpeechRecognition?

No, la instalación de la librería SpeechRecognition en Python es muy sencilla y se realiza con un único comando: pip install SpeechRecognition. Esto la hace accesible para desarrolladores de todos los niveles.

¿Qué es la prosodia en TTS y por qué es importante?

La prosodia se refiere a la entonación, el ritmo, el énfasis y las pausas en el habla humana. Es crucial para que la voz generada suene natural y transmita el significado y la emoción correctos. Es uno de los aspectos más complejos de replicar en la síntesis de voz.

¿Cuáles son las ventajas de usar redes neuronales en TTS?

Las redes neuronales han revolucionado el TTS al permitir la generación de voces extremadamente naturales y expresivas. Superan las limitaciones de los métodos anteriores al manejar mejor la prosodia, ofrecer mayor flexibilidad para ajustar parámetros y requerir menos almacenamiento para los modelos de voz.

En resumen, la capacidad de las máquinas para hablar y entender la voz ha pasado de ser una curiosidad tecnológica a una herramienta indispensable que mejora la accesibilidad, la eficiencia y la interacción en innumerables aplicaciones. Desde la simple instalación de una librería como SpeechRecognition hasta la comprensión de las complejas interacciones de los modelos de inteligencia artificial que dan vida a las voces digitales, el camino para crear sistemas de voz es tan fascinante como útil. Esperamos que este artículo te inspire a explorar las infinitas posibilidades que ofrece este campo en constante evolución, permitiéndonos, como programadores, dar voz a quienes no la tienen y hacer que la tecnología sea más accesible para todos.

Si quieres conocer otros artículos parecidos a Domina la Síntesis de Voz: De la Instalación a la Creación puedes visitar la categoría Librerías.