25/02/2024

En el vertiginoso mundo de la tecnología y la información, la ciencia de datos emerge como una disciplina crucial para extraer conocimiento y tomar decisiones informadas. En este escenario, un lenguaje de programación se ha erigido como el campeón indiscutible: Python. Su popularidad no es casualidad; se debe a una combinación única de facilidad de uso, versatilidad y, lo más importante, un ecosistema de bibliotecas tan vasto como potente, que lo convierte en la herramienta predilecta para científicos de datos y expertos en aprendizaje automático.

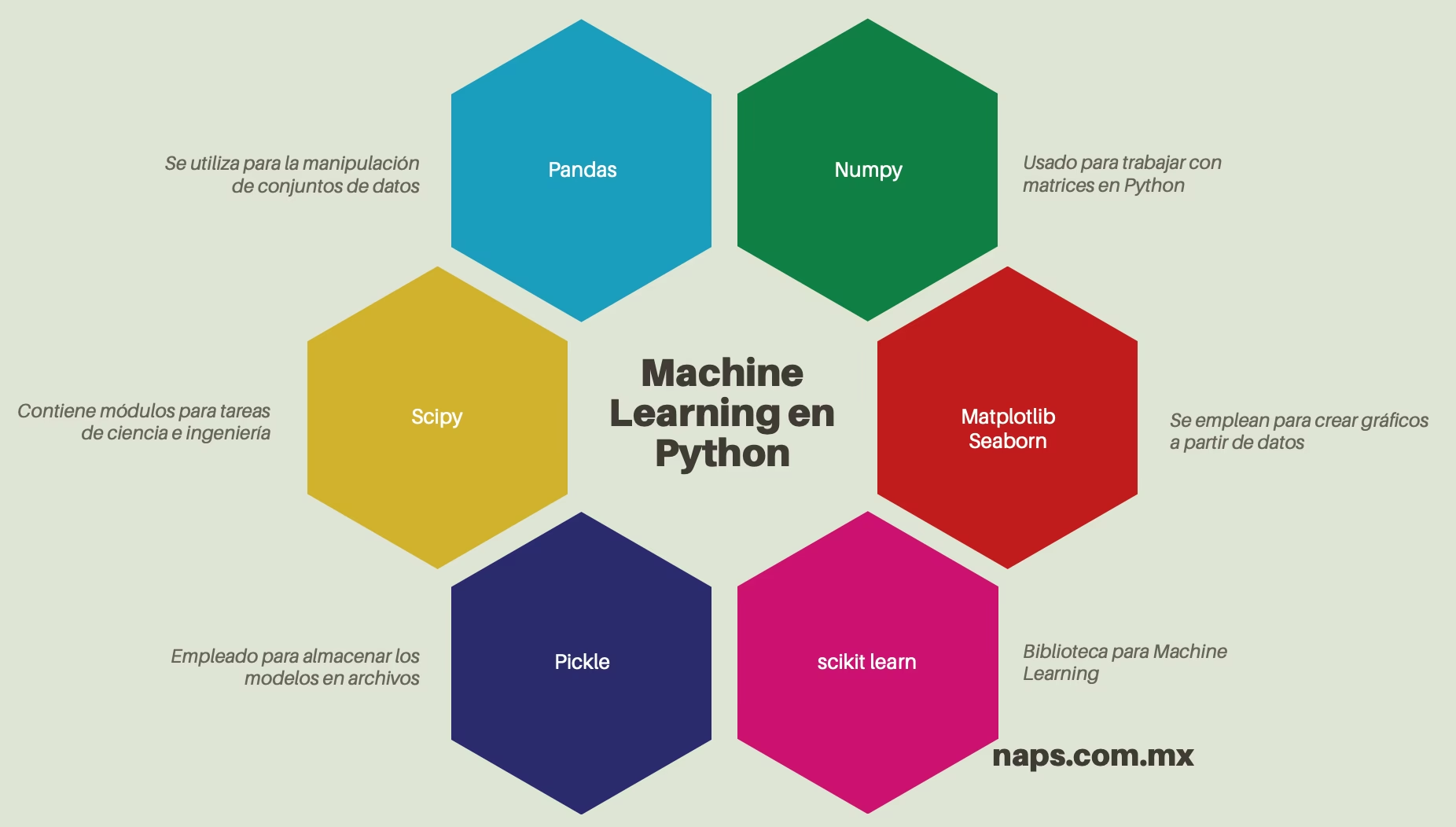

Python, un lenguaje de alto nivel, orientado a objetos y con una sintaxis excepcionalmente legible, ha democratizado el acceso a complejas tareas de computación. Con más de 137.000 bibliotecas disponibles, ofrece soluciones preconstruidas para casi cualquier desafío. Pero, ¿qué hace que este lenguaje sea tan valioso específicamente para la ciencia de datos? La respuesta reside en su impresionante colección de herramientas dedicadas a la manipulación, visualización, análisis, aprendizaje automático y aprendizaje profundo de datos. A continuación, exploraremos las joyas de la corona de Python que impulsan la revolución de los datos.

- Las Librerías Fundamentales de Python para la Ciencia de Datos

- Visualizando Datos con Estilo: Las Librerías Gráficas

- El Cerebro Detrás del Aprendizaje Automático

- Profundizando: Aprendizaje Profundo con Python

- Comunicación con las Máquinas: Procesamiento del Lenguaje Natural

- Preguntas Frecuentes sobre Python en Ciencia de Datos

- ¿Es Python el único lenguaje para la ciencia de datos?

- ¿Necesito aprender todas estas librerías para ser un científico de datos?

- ¿Cuál es la diferencia entre Machine Learning y Deep Learning?

- ¿Es Python fácil de aprender para la ciencia de datos?

- ¿Dónde puedo empezar a aprender Python para ciencia de datos?

Las Librerías Fundamentales de Python para la Ciencia de Datos

NumPy: El Corazón Numérico

Cuando hablamos de computación científica en Python, el primer nombre que viene a la mente es NumPy. Esta biblioteca de código abierto es la base sobre la que se construyen muchas otras. Su principal fortaleza radica en su capacidad para manejar arreglos (arrays) multidimensionales y grandes conjuntos de datos de manera extremadamente eficiente. Las funciones matemáticas integradas de NumPy permiten realizar operaciones a la velocidad de la luz, superando con creces el rendimiento de las listas nativas de Python, especialmente en tareas de álgebra lineal.

Creada en 2005, NumPy es un proyecto de código abierto bajo la licencia BSD modificada, lo que garantiza su libre acceso y uso para todos. Su desarrollo colaborativo en GitHub, con el consenso de la comunidad científica, asegura su constante evolución y relevancia. Es una herramienta indispensable para cualquiera que trabaje con datos numéricos de forma intensiva.

Pandas: El Maestro de la Manipulación de Datos

Si NumPy es el corazón, Pandas es el cerebro de la manipulación de datos en Python. Esta biblioteca de código abierto es la herramienta de facto para el análisis, manipulación y limpieza de datos. Su estructura de datos estrella, el DataFrame, permite modelar y operar con datos de forma rápida y eficiente, sin necesidad de escribir grandes cantidades de código. Piensa en un DataFrame como una hoja de cálculo potente y flexible, pero programable.

Entre sus características clave, Pandas facilita la lectura y escritura de datos entre estructuras en memoria y diversos formatos (CSV, Excel, SQL, HDF5). Ofrece segmentación inteligente basada en etiquetas, indexación elegante y subconjuntos de grandes conjuntos de datos. Además, su potente motor groupby permite la agregación y transformación de datos, mientras que su funcionalidad de series temporales es inigualable para trabajar con datos secuenciales. Cuando la eficiencia es crítica, Pandas también permite trabajar con rutas de código escritas en C o Cython.

Visualizando Datos con Estilo: Las Librerías Gráficas

La visualización de datos es un pilar fundamental en la ciencia de datos, permitiendo comunicar hallazgos complejos de manera clara y efectiva. Python ofrece un abanico de opciones para crear gráficos impresionantes.

Matplotlib: El Lienzo Básico

Matplotlib es la biblioteca fundacional para crear visualizaciones estáticas, interactivas y animadas en Python. Inspirada en MATLAB, ofrece un control granular sobre cada aspecto de un gráfico. Desde scatterplots hasta histogramas, gráficos de barras o boxplots, Matplotlib puede generar una amplia variedad de visualizaciones con solo unas pocas líneas de código. Su naturaleza de código abierto y gratuita la convierte en una opción accesible y potente, y sirve como base para muchas otras librerías de visualización de nivel superior.

Seaborn: Estilo y Estadísticas

Basado en Matplotlib, Seaborn eleva la visualización estadística a un nuevo nivel. Esta interfaz de alto nivel se enfoca en crear visualizaciones estéticamente atractivas y valiosas para el estudio y la comprensión de los datos. Su estrecha conexión con las estructuras de datos de NumPy y Pandas facilita la creación de gráficos complejos con gran facilidad. El principio rector de Seaborn es integrar la visualización como un componente esencial del análisis y la exploración de datos, utilizando algoritmos que abarcan conjuntos de datos enteros para revelar patrones y relaciones.

Plotly: Interactividad al Instante

Para visualizaciones interactivas y gráficos tipo dashboard, Plotly es una excelente alternativa. Construida sobre la biblioteca JavaScript Plotly.js, permite crear gráficos basados en la web que pueden guardarse como archivos HTML o incrustarse en notebooks de Jupyter y aplicaciones web (usando Dash). Ofrece más de 40 tipos de gráficos únicos, incluyendo gráficos de escalera, histogramas, diagramas de caja y gráficos 3D, e incluso gráficos de contorno, que no son tan comunes en otras bibliotecas. Si la interactividad es su prioridad, Plotly es una elección sólida.

| Característica | Matplotlib | Seaborn | Plotly |

|---|---|---|---|

| Nivel de Abstracción | Bajo (Control Fino) | Alto (Estadístico) | Alto (Interactivo) |

| Interactividad | Limitada | Limitada | Alta |

| Estética por Defecto | Básica | Avanzada | Moderna |

| Tipos de Gráficos | Generalista | Estadísticos | Diversos, 3D, Web |

| Facilidad de Uso | Requiere más código | Más fácil para estadísticas | Fácil para interactivos |

| Uso Principal | Personalización, Base | Exploración de datos, Informes | Dashboards, Aplicaciones Web |

El Cerebro Detrás del Aprendizaje Automático

Python es el hogar de algunas de las bibliotecas más influyentes en el campo del aprendizaje automático, desde algoritmos clásicos hasta técnicas de vanguardia.

Scikit-learn es, sin duda, una de las bibliotecas de aprendizaje automático más utilizadas en Python. Construida sobre NumPy, SciPy y Matplotlib, es una biblioteca de código abierto con licencia BSD, lo que la hace comercialmente utilizable. Su enfoque es proporcionar una herramienta simple y eficiente para tareas de análisis de datos predictivos. Ofrece una amplia gama de algoritmos de clasificación, regresión, agrupamiento, reducción de dimensionalidad y selección de modelos, todo con una API consistente y fácil de usar.

Iniciado en 2007, Scikit-learn es un proyecto impulsado por la comunidad, con un fuerte apoyo institucional y privado que asegura su sostenibilidad. Su facilidad de uso y la robustez de sus implementaciones lo hacen indispensable tanto para principiantes como para profesionales.

Boosters de Gradiente: Potencia y Precisión

El aprendizaje automático ha visto un auge en los algoritmos de potenciación de gradiente, y Python ofrece implementaciones líderes:

- LightGBM: Esta biblioteca de código abierto, inmensamente popular, emplea algoritmos basados en árboles con una velocidad de entrenamiento superior, mayor eficiencia y menor uso de memoria. Soporta aprendizaje paralelo, distribuido y GPU, y es capaz de manejar datos a gran escala.

- XGBoost: Otro buque insignia, XGBoost (eXtreme Gradient Boosting) es conocido por su portabilidad, flexibilidad y eficiencia. Ha ganado una enorme popularidad por su rendimiento en competiciones de datos estructurados como Kaggle. Ofrece árboles de decisión potenciados por gradiente (GBDT) y funciona en entornos distribuidos, siendo utilizado en producción por numerosas organizaciones.

- CatBoost: Desarrollado por Yandex, CatBoost es un algoritmo de potenciación de gradiente en árboles de decisión que destaca por su rendimiento superior en muchos conjuntos de datos, especialmente con variables categóricas. Ofrece una velocidad de predicción de su clase, excelente soporte de GPU y herramientas de visualización integradas.

Statsmodels: El Rigor Estadístico

Mientras que Scikit-learn se centra en el aprendizaje predictivo, Statsmodels se dedica a proporcionar clases y funciones para estimar diferentes modelos estadísticos, realizar pruebas estadísticas y explorar datos estadísticamente. Incluye funciones avanzadas para regresión lineal y logística, análisis de series temporales, y funciona perfectamente con DataFrames de Pandas. Su rigor estadístico y la verificación de resultados con otros paquetes como R, Stata o SAS lo convierten en una herramienta confiable para la inferencia estadística.

RAPIDS.AI: Aceleración por GPU

Para la ciencia de datos a gran escala, RAPIDS.AI, apoyado por NVIDIA, ofrece una suite de bibliotecas de software de código abierto que ejecutan los pipelines de ciencia y análisis de datos de extremo a extremo en GPUs. Esto acelera drásticamente los flujos de trabajo.

- cuDF: Una biblioteca de DataFrames acelerada por GPU, similar a Pandas en su API, pero construida sobre el formato de memoria columnar de Apache Arrow. Permite cargar, unir, agregar, filtrar y manipular datos con una velocidad sin precedentes.

- cuML: Una suite de bibliotecas que implementa algoritmos de aprendizaje automático y funciones matemáticas primitivas en GPUs, compartiendo APIs compatibles con Scikit-learn. Permite a científicos de datos llevar a cabo tareas tabulares tradicionales en GPUs sin profundizar en la programación CUDA.

Profundizando: Aprendizaje Profundo con Python

El aprendizaje profundo, una rama del aprendizaje automático, ha revolucionado campos como la visión por computadora y el procesamiento del lenguaje natural. Python es el lenguaje preferido para esta disciplina.

TensorFlow: El Gigante de Google

Desarrollado por el equipo de Google Brain, TensorFlow es una plataforma de código abierto de extremo a extremo para el aprendizaje automático y una base en la investigación del aprendizaje profundo. Permite cálculos numéricos complejos de manera escalable, tanto en CPU como en GPU. Es rico en API, ofreciendo interfaces de bajo y alto nivel en Python y C. Sus características incluyen la facilidad para desarrollar modelos, la disponibilidad de modelos y conjuntos de datos preentrenados, y TensorBoard, una herramienta de visualización para seguir experimentos. Su adopción de Keras como su API por defecto en TF 2.0 solidifica su posición como líder.

PyTorch: La Flexibilidad de Facebook

PyTorch, desarrollado y mantenido por Facebook, es un marco de aprendizaje automático que acelera el viaje desde el prototipo de investigación hasta el despliegue en producción. Es una biblioteca de tensores optimizada para el aprendizaje profundo, utilizando GPUs y CPUs, y se considera una alternativa poderosa a TensorFlow. Destaca por su capacidad de cambiar sin problemas entre modos entusiasta y gráfico con TorchScript, y su enfoque en el entrenamiento distribuido escalable. PyTorch cuenta con un rico ecosistema de herramientas y bibliotecas que amplían su funcionalidad en visión por computadora, NLP y más.

Keras: Aprendizaje Profundo para Humanos

Mientras que TensorFlow y PyTorch son los motores, Keras es la interfaz amigable. Diseñada para los seres humanos, no para las máquinas, Keras es una API de aprendizaje profundo que sigue las mejores prácticas para reducir la carga cognitiva. Ofrece APIs consistentes y simples, minimiza las acciones de usuario necesarias para casos de uso comunes y proporciona mensajes de error claros. Su modularidad, expresividad y flexibilidad la hacen ideal para la investigación innovadora y la depuración. Al ser adoptada por TensorFlow como su API predeterminada, su importancia es innegable.

FastAI: Rápidos Resultados, Gran Flexibilidad

FastAI es una biblioteca de aprendizaje profundo que combina componentes de alto nivel para generar resultados de alto nivel sin esfuerzo, con componentes de bajo nivel que pueden intercambiarse para desarrollar nuevos enfoques. Ofrece un sistema de despacho de tipos para Python, una biblioteca de visión por computadora optimizada para GPU completamente extensible, un optimizador refactorizado que permite implementar algoritmos de optimización en pocas líneas de código, y un sistema de devolución de llamada bidireccional para acceder y modificar cualquier componente del modelo durante el entrenamiento.

PyTorch Lightning: Ingeniería de DL Organizada

Para aquellos que buscan organizar su código de PyTorch de manera más estructurada, PyTorch Lightning ofrece una interfaz de alto nivel. Este marco ligero y de alto rendimiento organiza el código de PyTorch para separar la investigación de la ingeniería, haciendo que los experimentos de aprendizaje profundo sean más fáciles de entender y reproducir. Permite ejecutar código en cualquier hardware, perfilar el rendimiento, realizar puntos de control del modelo, utilizar precisión de 16 bits y ejecutar entrenamiento distribuido, todo ello con el objetivo de que los investigadores dediquen más tiempo a la ciencia y menos a la complejidad del código.

Comunicación con las Máquinas: Procesamiento del Lenguaje Natural

El procesamiento del lenguaje natural (PLN) es otro campo donde Python brilla, permitiendo a las máquinas entender, interpretar y generar lenguaje humano.

spaCy: PLN Industrial

spaCy es una biblioteca de procesamiento de lenguaje natural de fuerza industrial y de código abierto en Python. Destaca en tareas de extracción de información a gran escala y está escrita en Cython para una gestión de memoria cuidadosa y un rendimiento de última generación. Es ideal para aplicaciones que necesitan procesar enormes volúmenes de texto. Soporta procesamiento de CPU y GPU, ofrece soporte para más de 66 idiomas con 73 pipelines entrenados, aprendizaje multitarea con transformadores preentrenados como BERT, y componentes para reconocimiento de entidades nombradas, etiquetado de partes del discurso, análisis de dependencia, y más. También cuenta con visualizadores incorporados y soporte para modelos personalizados de TensorFlow y PyTorch.

Hugging Face Transformers: El Futuro del PLN

Hugging Face Transformers es una biblioteca que ha revolucionado el PLN al permitir descargar y entrenar fácilmente modelos preentrenados de vanguardia. Utilizar estos modelos reduce drásticamente los costos de computación y el tiempo de entrenamiento. La biblioteca soporta una variedad de modalidades, incluyendo texto (clasificación, extracción, traducción, resumen, generación), imágenes (clasificación, detección, segmentación), audio (reconocimiento de voz, clasificación) y multimodal (respuesta a preguntas en tablas, OCR). Su integración sin fisuras entre PyTorch, TensorFlow y JAX permite entrenar un modelo en un marco y cargarlo para inferencia en otro, haciendo la experimentación y la investigación extremadamente flexibles.

Preguntas Frecuentes sobre Python en Ciencia de Datos

¿Es Python el único lenguaje para la ciencia de datos?

No, Python no es el único lenguaje utilizado en ciencia de datos. Otros lenguajes como R, Julia, Scala y Java también tienen su lugar. Sin embargo, Python se ha convertido en el más popular y dominante debido a su versatilidad, su curva de aprendizaje suave, la gran cantidad de recursos disponibles y, lo más importante, su inigualable ecosistema de bibliotecas especializadas que cubren prácticamente todas las necesidades de la ciencia de datos.

¿Necesito aprender todas estas librerías para ser un científico de datos?

Absolutamente no. La lista presentada es extensa para mostrar la amplitud del ecosistema de Python. Como científico de datos, te especializarás en ciertas áreas. Es fundamental dominar NumPy y Pandas para la manipulación de datos, y al menos una biblioteca de visualización como Matplotlib o Seaborn. Para el aprendizaje automático, Scikit-learn es un excelente punto de partida. Las librerías de aprendizaje profundo o PLN se aprenden a medida que tu rol lo requiera. El enfoque debe ser en entender los conceptos y luego elegir la herramienta adecuada.

¿Cuál es la diferencia entre Machine Learning y Deep Learning?

El aprendizaje automático (Machine Learning) es un campo de la inteligencia artificial que permite a los sistemas aprender de los datos, identificar patrones y tomar decisiones con una mínima intervención humana. El aprendizaje profundo (Deep Learning) es un subcampo del aprendizaje automático que utiliza redes neuronales artificiales con múltiples capas (de ahí 'profundo') para modelar abstracciones de alto nivel en los datos. Mientras que el Machine Learning abarca una gama más amplia de algoritmos (como regresión lineal, árboles de decisión, etc.), el Deep Learning se enfoca en redes neuronales complejas, especialmente potentes para datos no estructurados como imágenes, audio y texto.

¿Es Python fácil de aprender para la ciencia de datos?

Sí, Python es considerado uno de los lenguajes de programación más fáciles de aprender, especialmente para principiantes. Su sintaxis clara y legible, junto con una gran comunidad y abundantes recursos educativos (tutoriales, cursos, documentación), lo hacen muy accesible. Esto permite a los aspirantes a científicos de datos concentrarse más en los conceptos de los datos y los algoritmos, y menos en las complejidades del lenguaje.

¿Dónde puedo empezar a aprender Python para ciencia de datos?

Puedes empezar con recursos en línea gratuitos como tutoriales interactivos, cursos MOOC (Coursera, edX, Udacity), la documentación oficial de Python y de las bibliotecas clave (NumPy, Pandas). Practicar con pequeños proyectos y unirse a comunidades en línea (como Kaggle o foros especializados) te ayudará a consolidar tus conocimientos y a mantenerte actualizado con las últimas tendencias.

Si quieres conocer otros artículos parecidos a Python: El Pilar de la Ciencia de Datos Moderna puedes visitar la categoría Librerías.