05/04/2023

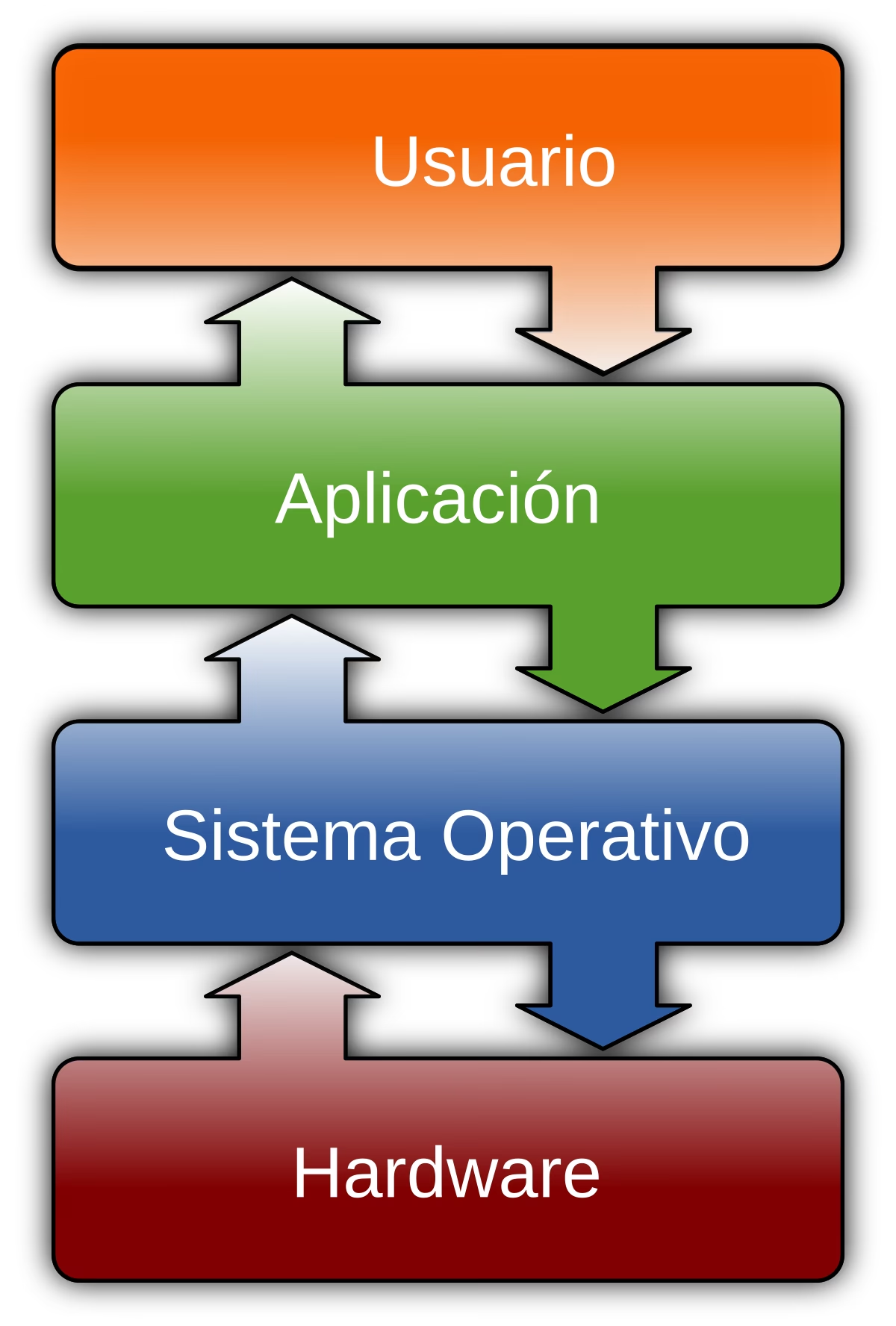

En el núcleo de cualquier sistema operativo moderno, la capacidad de ejecutar múltiples tareas simultáneamente es fundamental. Detrás de cada aplicación que abres, cada pestaña de tu navegador, o incluso cada función interna del propio sistema, existe una entidad fundamental: el proceso. Comprender qué es un proceso, cómo se crea, cómo interactúa y cómo es gestionado por el sistema operativo es clave para entender el funcionamiento de cualquier computadora. Un proceso no es simplemente un programa; es una instancia en ejecución de un programa, con su propio espacio de memoria, recursos asignados y estado de ejecución.

La vida de un proceso es dinámica y está intrínsecamente ligada a la gestión del sistema operativo. Desde su nacimiento, a menudo a partir de otro proceso ya existente, hasta su eventual terminación, cada paso es orquestado para garantizar la estabilidad y eficiencia del sistema. Esta interconexión y jerarquía de procesos es lo que permite que tu computadora realice múltiples funciones sin problemas aparentes, desde reproducir música hasta procesar documentos complejos, todo al mismo tiempo.

- ¿Qué es Realmente un Proceso?

- El Ciclo de Vida de un Proceso: Estados Clave

- Creación de Procesos: Padres e Hijos

- Terminación de Procesos

- Gestión de Procesos: El Rol del Planificador

- Comunicación Interproceso (IPC)

- Procesos vs. Hilos (Threads)

- Preguntas Frecuentes sobre Procesos del Sistema Operativo

- Conclusión

¿Qué es Realmente un Proceso?

Para la mayoría de los usuarios, un programa y un proceso son términos intercambiables. Sin embargo, para un sistema operativo, la distinción es crucial. Un programa es una colección de instrucciones y datos almacenados en un archivo ejecutable en el disco duro. Es una entidad pasiva. Un proceso, por otro lado, es una instancia activa y en ejecución de ese programa. Cuando ejecutas un programa, el sistema operativo crea un proceso para él. Este proceso no solo incluye el código del programa, sino también:

- El contador de programa: Indica la siguiente instrucción a ejecutar.

- El conjunto de registros de la CPU: Almacena el estado actual de la CPU para ese proceso.

- La pila (stack): Contiene datos temporales como parámetros de funciones, direcciones de retorno y variables locales.

- La sección de datos (heap): Contiene variables globales y dinámicas.

- El espacio de direcciones: La memoria virtual asignada al proceso.

- Recursos del sistema: Archivos abiertos, dispositivos de E/S, señales pendientes, etc.

En esencia, un proceso es una unidad de trabajo que el sistema operativo puede programar y gestionar. Cada proceso tiene su propio entorno aislado para evitar que interfiera con otros procesos, lo que contribuye a la estabilidad y seguridad del sistema.

El Ciclo de Vida de un Proceso: Estados Clave

Un proceso no permanece estático desde su creación hasta su terminación. A lo largo de su existencia, pasa por diferentes estados, reflejando su actividad y su relación con el planificador de procesos del sistema operativo. Los estados más comunes de un proceso son:

1. Nuevo (New)

Cuando se solicita la creación de un proceso (por ejemplo, al hacer doble clic en un icono de una aplicación), este entra en el estado 'Nuevo'. En este estado, el sistema operativo está preparando los recursos necesarios para el proceso, como la asignación de memoria, la carga del código del programa y la inicialización del bloque de control de proceso (PCB).

2. Listo (Ready)

Una vez que el proceso ha sido creado y está listo para ser ejecutado, pero el CPU no está disponible, pasa al estado 'Listo'. Los procesos en este estado esperan en una cola, listos para ser seleccionados por el planificador de procesos y asignados al CPU. Piensa en ello como una sala de espera donde todos están listos para ser atendidos.

3. Ejecución (Running)

Cuando el planificador de procesos selecciona un proceso del estado 'Listo' y le asigna el CPU, el proceso entra en el estado 'Ejecución'. En este estado, las instrucciones del programa se están ejecutando activamente. Un sistema con un solo CPU solo puede tener un proceso en estado 'Ejecución' en un momento dado. En sistemas multi-núcleo, puede haber tantos procesos en ejecución como núcleos disponibles.

4. Espera/Bloqueado (Waiting/Blocked)

Un proceso entra en el estado 'Espera' cuando necesita realizar una operación que requiere tiempo y no puede continuar su ejecución hasta que esa operación se complete. Ejemplos comunes incluyen la espera de la finalización de una operación de E/S (como leer de un disco o la entrada del usuario), o la espera de un recurso que está siendo utilizado por otro proceso. Una vez que la operación se completa, el proceso vuelve al estado 'Listo'.

5. Terminado (Terminated)

Cuando un proceso ha completado su ejecución (ya sea normalmente o debido a un error), o ha sido abortado por el sistema operativo o por otro proceso, entra en el estado 'Terminado'. En este estado, el proceso ya no está activo, pero el sistema operativo aún puede mantener cierta información sobre él (como su código de salida) para fines de contabilidad o para que el proceso padre la recoja. Una vez que toda la información se ha recogido y los recursos se han liberado, el proceso desaparece completamente.

Esta tabla resume los estados y transiciones:

| Estado del Proceso | Descripción | Transiciones Comunes |

|---|---|---|

| Nuevo | Proceso siendo creado; recursos inicializados. | Nuevo → Listo |

| Listo | Preparado para ejecutar; esperando CPU. | Listo → Ejecución (por planificador) |

| Ejecución | Instrucciones ejecutándose activamente en el CPU. | Ejecución → Listo (por interrupción), Ejecución → Espera (por E/S), Ejecución → Terminado |

| Espera/Bloqueado | Esperando un evento (E/S, recurso, etc.). | Espera → Listo (al completarse evento) |

| Terminado | Proceso finalizado; recursos liberados o pendientes de liberación. | Cualquier estado → Terminado |

Creación de Procesos: Padres e Hijos

Como se mencionó, los procesos de un sistema son creados a partir de otro proceso. Al creador se le denomina padre y al nuevo proceso hijo. Esta relación jerárquica es fundamental en la arquitectura de los sistemas operativos tipo Unix/Linux, donde el primer proceso (init o systemd) es el ancestro de todos los demás. En Windows, si bien existe una jerarquía, es menos estricta en términos de herencia directa de todos los atributos.

Cuando un proceso padre crea un proceso hijo, se deben tomar decisiones cruciales sobre qué recursos se compartirán y cuáles se duplicarán. Generalmente, existen dos modelos principales:

- Compartir todos los recursos: Este modelo es menos común para procesos separados, ya que la independencia es un objetivo clave. Sin embargo, es el modelo subyacente para los hilos (threads) dentro de un mismo proceso.

- Compartir algunos recursos y duplicar otros: Este es el modelo más común para la creación de procesos.

Los recursos que típicamente se duplican o se manejan de forma independiente para el proceso hijo incluyen:

- Espacio de direcciones de memoria: Cada proceso tiene su propio espacio de memoria virtual. Aunque el proceso hijo puede inicialmente tener una copia de la memoria del padre (técnica Copy-on-Write), cualquier modificación que haga el hijo no afectará la memoria del padre y viceversa.

- Registros de la CPU: El estado de los registros de la CPU del hijo se inicializa independientemente.

- ID de proceso (PID): Cada proceso tiene un PID único asignado por el sistema operativo.

Los recursos que a menudo se heredan o comparten entre padre e hijo incluyen:

- Archivos abiertos: El proceso hijo a menudo hereda una copia de los descriptores de archivo abiertos por el padre. Esto permite que el hijo continúe operaciones de E/S iniciadas por el padre.

- Señales: Las máscaras de señal y las acciones de señal pueden ser heredadas.

- Prioridad: La prioridad de programación puede ser heredada.

El mecanismo más famoso para la creación de procesos es la llamada al sistema fork() (en sistemas Unix/Linux). fork() crea una copia casi idéntica del proceso padre. Después de fork(), tanto el padre como el hijo continúan la ejecución desde el punto de la llamada. A menudo, después de fork(), el proceso hijo realiza una llamada a exec() para cargar y ejecutar un nuevo programa, reemplazando así su propio espacio de memoria con el del nuevo programa. Esto es fundamental para ejecutar nuevas aplicaciones.

Terminación de Procesos

Un proceso puede terminar por varias razones:

- Salida normal (exit): El proceso completa su tarea y llama a una función de salida (como

exit()en C) para indicar al sistema operativo que ha terminado. - Error fatal: Un error irrecuperable dentro del proceso (ej. división por cero, acceso a memoria inválida) que causa una terminación anormal.

- Terminación por otro proceso: Un proceso padre puede terminar a un proceso hijo, o un usuario puede terminar un proceso manualmente (ej. usando el Administrador de Tareas en Windows o

killen Linux). - Terminación por el sistema operativo: El sistema operativo puede terminar procesos por razones de seguridad, recursos insuficientes, o para mantener la estabilidad del sistema.

Cuando un proceso termina, el sistema operativo libera sus recursos (memoria, descriptores de archivo, etc.). En algunos casos, un proceso hijo puede convertirse en un 'proceso zombie' si termina pero su proceso padre no ha recogido su estado de salida. Estos procesos zombies no consumen CPU ni memoria activa, pero mantienen una entrada en la tabla de procesos hasta que el padre los recoja o el sistema se reinicie.

Gestión de Procesos: El Rol del Planificador

Con múltiples procesos compitiendo por los recursos limitados del sistema, especialmente el CPU, el sistema operativo necesita un componente crucial: el planificador de procesos (o scheduler). Su función principal es decidir qué proceso, de entre todos los que están en estado 'Listo', debe ejecutar a continuación en el CPU. Los algoritmos de planificación varían enormemente (FIFO, Round Robin, Prioridad, etc.) y tienen un impacto significativo en el rendimiento y la capacidad de respuesta del sistema.

El planificador utiliza interrupciones (por tiempo, por E/S, etc.) para quitar el CPU a un proceso en ejecución y dárselo a otro. Este cambio de un proceso a otro se conoce como cambio de contexto (context switch). Un cambio de contexto implica guardar el estado actual del proceso que se va a detener y cargar el estado del nuevo proceso. Es una operación costosa en términos de tiempo, por lo que los sistemas operativos buscan minimizar su frecuencia mientras mantienen una buena capacidad de respuesta.

Comunicación Interproceso (IPC)

Aunque los procesos están diseñados para ser aislados, a menudo necesitan comunicarse e intercambiar datos entre sí para realizar tareas complejas. Los mecanismos de Comunicación Interproceso (IPC) permiten esta interacción. Algunos de los métodos más comunes incluyen:

- Pipes (Tuberías): Permiten la comunicación unidireccional entre procesos relacionados (padre-hijo o hermanos).

- Shared Memory (Memoria Compartida): Permite que múltiples procesos accedan a la misma región de memoria, lo que es muy eficiente pero requiere sincronización para evitar condiciones de carrera.

- Message Queues (Colas de Mensajes): Permiten el intercambio de mensajes discretos entre procesos, incluso no relacionados.

- Sockets: Permiten la comunicación entre procesos en la misma máquina o en diferentes máquinas a través de una red. Son la base de la comunicación de red.

- Semáforos y Mutexes: Aunque no son directamente para intercambio de datos, son mecanismos de sincronización esenciales para controlar el acceso a recursos compartidos y evitar problemas en IPC.

La elección del mecanismo IPC depende de los requisitos específicos de la aplicación, como la cantidad de datos a intercambiar, la necesidad de sincronización y la relación entre los procesos.

Procesos vs. Hilos (Threads)

Es importante distinguir entre procesos y hilos, ya que ambos representan unidades de ejecución, pero a diferentes niveles. Un hilo (o thread) es una unidad de ejecución ligera dentro de un proceso. Mientras que un proceso tiene su propio espacio de direcciones y recursos, los hilos dentro del mismo proceso comparten el mismo espacio de direcciones, código, datos globales y recursos abiertos (como archivos).

La principal diferencia radica en el nivel de aislamiento y los recursos compartidos:

| Característica | Proceso | Hilo (Thread) |

|---|---|---|

| Espacio de Direcciones | Propio y aislado | Compartido con otros hilos del mismo proceso |

| Recursos | Propios (archivos abiertos, señales, etc.) | Compartidos con otros hilos del mismo proceso |

| Independencia | Alto grado de independencia | Dependiente del proceso padre |

| Creación/Terminación | Más costoso en tiempo y recursos | Más ligero y rápido |

| Comunicación | Requiere IPC explícita | Acceso directo a datos compartidos (más rápido, pero requiere sincronización) |

| Fallo | Un fallo suele afectar solo al proceso | Un fallo suele afectar a todo el proceso |

Los hilos permiten que una aplicación realice múltiples tareas concurrentemente dentro del mismo proceso (multithreading), lo que es eficiente para aplicaciones que necesitan alta capacidad de respuesta o para aprovechar CPUs multi-núcleo sin la sobrecarga de múltiples procesos.

Preguntas Frecuentes sobre Procesos del Sistema Operativo

¿Qué diferencia hay entre un programa y un proceso?

Un programa es un conjunto pasivo de instrucciones almacenado en un archivo en el disco, mientras que un proceso es una instancia activa y en ejecución de ese programa, con sus propios recursos, memoria y estado de ejecución.

¿Por qué un proceso hijo hereda recursos del padre?

La herencia de recursos como los descriptores de archivo abiertos simplifica la programación y permite que el hijo continúe operaciones de E/S o acceda a recursos que ya fueron inicializados por el padre, facilitando la colaboración entre procesos relacionados.

¿Qué es un proceso 'zombie'?

Un proceso 'zombie' es un proceso que ha terminado su ejecución pero cuya entrada en la tabla de procesos del sistema operativo no ha sido eliminada porque su proceso padre no ha recogido su estado de salida. No consume CPU ni memoria activa, pero ocupa un PID y una entrada en la tabla de procesos. Son inofensivos, pero en gran número pueden agotar los PID disponibles.

¿Cómo se gestionan múltiples procesos en un solo CPU?

En un sistema con un solo CPU, el sistema operativo utiliza un planificador de procesos que alterna rápidamente la ejecución de diferentes procesos. Esto se logra mediante cambios de contexto rápidos, dando la ilusión de paralelismo a pesar de que solo un proceso se está ejecutando en un momento dado. Esto se conoce como multitarea por tiempo compartido.

¿Cuál es el Bloque de Control de Proceso (PCB)?

El Bloque de Control de Proceso (PCB) es una estructura de datos crucial que el sistema operativo utiliza para almacenar toda la información relevante sobre un proceso. Cada proceso tiene su propio PCB, que contiene su estado actual, contador de programa, valores de registros, información de planificación (prioridad), información de gestión de memoria, información de contabilidad (tiempo de CPU usado) e información de estado de E/S. Esencialmente, el PCB es el 'pasaporte' y 'currículum vitae' de un proceso para el sistema operativo.

Conclusión

Los procesos son la columna vertebral de cualquier sistema operativo moderno, permitiendo la ejecución concurrente de múltiples tareas y la capacidad de respuesta que esperamos de nuestras computadoras. Desde la intrincada danza de su creación y terminación, pasando por sus diversos estados de vida, hasta la compleja gestión por parte del planificador y la vital comunicación entre ellos, cada aspecto de la gestión de procesos es un testimonio de la sofisticación del diseño del sistema operativo. Comprender estos mecanismos no solo nos da una visión más profunda de cómo funciona la tecnología que usamos a diario, sino que también subraya la importancia de una gestión eficiente de recursos para un rendimiento óptimo y una experiencia de usuario fluida.

Si quieres conocer otros artículos parecidos a Explorando los Procesos de un Sistema Operativo puedes visitar la categoría Librerías.