03/01/2023

En la era digital actual, la interacción entre humanos y máquinas está evolucionando rápidamente, y los agentes de voz se encuentran a la vanguardia de esta transformación. Desde asistentes virtuales y sistemas de automatización del hogar hasta robots de atención al cliente y dispositivos de tecnología asistida, la tecnología de voz facilita una interacción más intuitiva y manos libres. Esta creciente demanda requiere herramientas más capaces y flexibles que permitan a los desarrolladores crear agentes de voz sofisticados. Si te has preguntado sobre el costo de la Google Speech API para tu aplicación comercial o si CMUSphinx es tu mejor opción, estás en el lugar correcto. A continuación, exploraremos las principales bibliotecas de Python de código abierto que te ayudarán a construir agentes de voz robustos y eficientes, abordando tus necesidades de escalabilidad, facilidad de implementación y, sobre todo, la búsqueda de soluciones gratuitas u offline.

- ¿Es Gratuita la Google Speech API para Aplicaciones Comerciales?

- ¿Qué es una Biblioteca de Reconocimiento de Voz?

- Agentes de Voz: Transformando la Interacción Humano-Máquina

- Top 10 Bibliotecas Python de Código Abierto para Construir Agentes de Voz

- Tabla Comparativa de Bibliotecas Clave para Agentes de Voz

- Aplicaciones de los Agentes de Voz en el Mundo Real

- Conclusión

- Preguntas Frecuentes

- P1. ¿Qué es un agente de voz?

- P2. ¿Cómo funcionan los agentes de voz?

- P3. ¿Qué bibliotecas se utilizan comúnmente para construir agentes de voz?

- P4. ¿Qué tan precisos son los agentes de voz impulsados por IA?

- P5. ¿Pueden los agentes de voz manejar múltiples idiomas?

- P6. ¿Cuáles son los mayores desafíos en el desarrollo de agentes de voz?

- P7. ¿Son seguros los agentes de voz para manejar datos sensibles?

¿Es Gratuita la Google Speech API para Aplicaciones Comerciales?

La Google Speech API es una herramienta potente y precisa para el reconocimiento de voz. Sin embargo, cuando se trata de su uso en aplicaciones comerciales, especialmente aquellas que requieren un gran volumen de llamadas, su naturaleza 'gratuita' tiene matices importantes. Google Cloud Speech-to-Text ofrece un nivel gratuito que permite hasta 60 minutos de procesamiento de audio por mes. Después de superar este umbral, el servicio se vuelve de pago, con tarifas que se aplican cada 15 segundos de audio procesado. Para una aplicación comercial que necesita manejar muchas llamadas, este modelo de precios puede escalar rápidamente, convirtiéndose en un costo significativo. Por lo tanto, si bien es excelente para proyectos pequeños o pruebas, no es la opción más económica para una operación a gran escala que busca minimizar gastos, lo que justifica la búsqueda de alternativas de código abierto y soluciones offline.

¿Qué es una Biblioteca de Reconocimiento de Voz?

Una biblioteca de reconocimiento de voz es un conjunto de herramientas y algoritmos que permiten a las aplicaciones informáticas convertir el lenguaje hablado en texto escrito. Estas bibliotecas son el pilar fundamental para construir agentes de voz, ya que facilitan la comprensión de los comandos de voz del usuario. Además del reconocimiento de voz (Speech-to-Text o STT), muchas de estas bibliotecas también ofrecen funcionalidades de síntesis de texto a voz (Text-to-Speech o TTS), lo que permite a la máquina responder al usuario de forma audible. Integran diversas tecnologías, como el procesamiento del lenguaje natural (PLN), para interpretar la intención y el significado detrás de las palabras, haciendo posible una interacción conversacional fluida.

Agentes de Voz: Transformando la Interacción Humano-Máquina

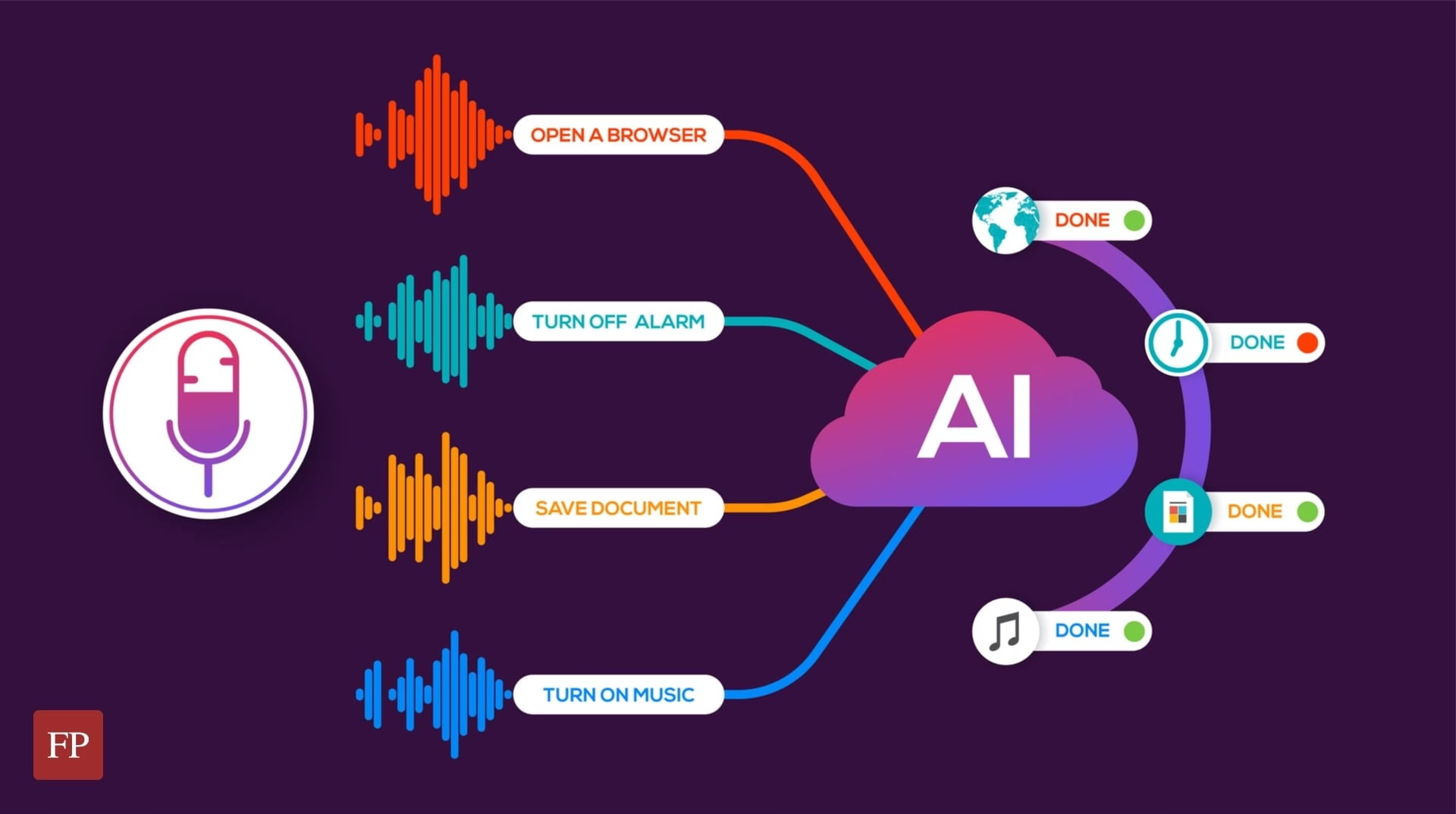

Un agente de voz es un sistema impulsado por inteligencia artificial capaz de comprender, procesar y responder a los comandos de los usuarios. Utilizan tecnologías de reconocimiento de voz, procesamiento del lenguaje natural (PLN) y síntesis de texto a voz para interactuar con los usuarios a través de comandos de voz. Los agentes de voz han encontrado amplias aplicaciones en asistentes virtuales como Siri y Google Assistant, así como en servicios como chatbots de atención al cliente, automatización de centros de llamadas, aplicaciones de automatización del hogar y soluciones de accesibilidad. Ayudan a las organizaciones a mejorar la eficiencia, la experiencia del usuario y la interacción manos libres para una variedad de aplicaciones.

Criterios para Seleccionar las Mejores Bibliotecas para Agentes de Voz

Un agente de voz exitoso depende de varios factores clave que trabajan en conjunto. Uno de los más básicos es el reconocimiento de voz y la conversión de texto (STT), que traduce las palabras habladas a texto escrito. La comprensión del lenguaje natural (NLU) también ayuda al sistema a entender la intención y el significado detrás de la palabra escrita. La conversión de texto a voz (TTS) es crucial para generar resultados hablados a partir de palabras escritas. Por último, la gestión de diálogos garantiza un flujo conversacional fluido y la relevancia del contexto. Las herramientas que ofrecen soporte para estas funcionalidades esenciales son de gran importancia para desarrollar agentes de voz exitosos.

Al seleccionar las bibliotecas, hemos considerado la facilidad con la que cada una puede ser aprendida e implementada en aplicaciones del mundo real. El rendimiento y la estabilidad fueron consideraciones clave, ya que los agentes de voz deben funcionar perfectamente en diversos entornos. También consideramos la licencia de código abierto de cada biblioteca para asegurar que puedan ser utilizadas con fines comerciales e incluso modificadas, lo cual es fundamental para el escenario planteado.

Top 10 Bibliotecas Python de Código Abierto para Construir Agentes de Voz

A continuación, exploraremos bibliotecas Python de código abierto que proporcionan las herramientas necesarias para el desarrollo de agentes de voz inteligentes y eficientes. Ya sea que estés creando un asistente de voz básico o un sistema complejo basado en IA, estas herramientas proporcionarán una buena base para el proceso de desarrollo.

1. SpeechRecognition

La biblioteca SpeechRecognition es una biblioteca popular y de código abierto para convertir palabras habladas en texto. Está diseñada para manejar más de un motor de reconocimiento de voz, lo que la convierte en una opción versátil para desarrolladores que crean agentes de voz, asistentes virtuales, herramientas de transcripción y otras herramientas de voz. La biblioteca permite una integración sencilla con servicios de reconocimiento de voz en línea y offline. Los desarrolladores pueden elegir el más adecuado según la precisión, la velocidad, la disponibilidad de internet y el precio.

- Compatibilidad con Motores de Reconocimiento de Voz: Funciona con Google Speech Recognition, Microsoft Azure Speech, IBM Speech to Text y motores offline como CMU Sphinx, Vosk API y OpenAI Whisper.

- Soporte de Entrada de Micrófono: Admite reconocimiento de voz en tiempo real utilizando la biblioteca PyAudio.

- Transcripción de Archivos de Audio: Procesa formatos de archivo como WAV, AIFF y FLAC para la conversión de voz a texto.

- Calibración de Ruido: Mejora la precisión del reconocimiento en entornos ruidosos.

- Monitoreo Continuo en Segundo Plano: Detecta palabras o comandos individuales en tiempo real.

2. Pyttsx3

Pyttsx3 es una biblioteca Python que se utiliza para sintetizar texto a voz sin necesidad de conectividad a internet. Esta característica la hace especialmente útil para aplicaciones que requieren una salida de voz offline confiable, como asistentes de voz, software de accesibilidad y asistentes de IA. A diferencia de las soluciones de texto a voz basadas en la nube, pyttsx3 se ejecuta solo en dispositivos locales. Esto garantiza la confidencialidad, reduce el tiempo de respuesta y proporciona independencia de la conectividad a internet. La biblioteca admite múltiples motores TTS en diferentes sistemas operativos (Windows: SAPI5, macOS: NSSpeechSynthesizer, Linux: eSpeak).

- Velocidad de Habla Ajustable: Acelera o ralentiza el habla según sea necesario.

- Control de Volumen: Modifica la sonoridad de la salida de voz.

- Selección de Voz: Elige entre voces masculinas y femeninas (dependiendo del motor).

- Generación de Archivos de Audio: Guarda el habla sintetizada como un archivo de audio para su uso posterior.

3. Vocode

Vocode es una biblioteca Python de código abierto para crear asistentes de voz en tiempo real basados en LLM (Large Language Models). Facilita la integración de reconocimiento de voz, texto a voz e IA conversacional. Es perfecta para asistentes telefónicos, agentes de atención al cliente automatizados y aplicaciones de voz en tiempo real. A través de Vocode, los desarrolladores pueden construir instantáneamente sistemas de voz de IA interactivos con facilidad que abarcan plataformas como llamadas telefónicas y reuniones de Zoom.

- Reconocimiento de Voz (STT): Soporte para AssemblyAI, Deepgram, Google Cloud, Microsoft Azure, RevAI, Whisper y Whisper.cpp.

- Texto a Voz (TTS): Compatibilidad con Rime.ai, Microsoft Azure, Google Cloud, Play.ht, Eleven Labs y gTTS.

- Grandes Modelos de Lenguaje (LLMs): Para interactuar con modelos creados por OpenAI y Anthropic para habilitar conversaciones de voz inteligentes.

- Streaming en Tiempo Real: Proporciona voz fluida y de baja latencia con agentes de voz de IA.

4. WhisperX

WhisperX es una biblioteca Python de alta precisión basada en el modelo Whisper de OpenAI, optimizada para aplicaciones de agentes de voz en tiempo real. Está especialmente optimizada para transcripción rápida, diarización de altavoces y capacidades multilingües. En comparación con el software simple de voz a texto, WhisperX maneja mejor los escenarios ruidosos y de múltiples altavoces, lo que lo hace perfecto para robots de servicio al cliente, servicios de transcripción y sistemas de IA conversacional.

- Transcripción Ultra-Rápida: Emplea inferencia por lotes para acelerar la conversión de voz a texto.

- Marcas de Tiempo Precisas a Nivel de Palabra: Alinea las transcripciones con wav2vec2 para una temporización adecuada.

- Diarización de Altavoces: Identifica múltiples hablantes dentro de una conversación a través de pyannote-audio.

- Detección de Actividad de Voz (VAD): VAD minimiza errores al eliminar ruidos de fondo no deseados.

- Soporte Multilingüe: Aumenta la precisión de la transcripción para idiomas no ingleses con modelos de alineación específicos del idioma.

5. Rasa

Rasa es un marco de aprendizaje automático de código abierto para construir asistentes de IA inteligentes, por ejemplo, agentes basados en voz. Está diseñado para la comprensión del lenguaje natural y la gestión de diálogos, y por lo tanto es una herramienta integral para procesar las interacciones del usuario. Rasa no proporciona una funcionalidad simple de STT (voz a texto) o TTS (texto a voz), sino que proporciona la capa de inteligencia para los asistentes de voz para que puedan interpretar el contexto y hablar de forma natural.

- NLU Avanzado: Deriva la intención del usuario y las entidades de las entradas de voz y texto.

- Gestión de Diálogos: Mantiene un diálogo sensible al contexto para diálogos de múltiples turnos.

- Compatibilidad Multiplataforma: Proporciona integración con Alexa Skills, Google Home Actions, Twilio, Slack y otros.

- Streaming de Voz Nativo: Transmite audio desde dentro de su pipeline para permitir la interacción en tiempo real.

- Adaptable y Flexible: Escala para soportar proyectos pequeños y asistentes de IA a nivel empresarial.

- Pipelines Configurables: Esto permite a los desarrolladores personalizar modelos NLU y añadir servicios STT/TTS.

6. Deepgram

Deepgram es una plataforma de texto a voz y reconocimiento de voz basada en la nube que proporciona soluciones de transcripción y síntesis rápidas, precisas y basadas en IA. Cuenta con una biblioteca cliente de Python, lo que permite una integración fluida con aplicaciones de agentes de voz. Con la adición de detección automática de idioma, identificación de hablantes y detección de palabras clave. Deepgram es una opción de alta potencia para el procesamiento de audio por lotes y en tiempo real dentro de los sistemas de IA conversacional. Aunque es de pago, su precisión y funciones avanzadas la hacen relevante para proyectos comerciales que buscan el mejor rendimiento.

- Reconocimiento de Voz de Alta Precisión: Emplea algoritmos de aprendizaje profundo para proporcionar transcripciones precisas.

- Soporte para Audio en Tiempo Real y Pregrabado: Procesa flujos de audio en tiempo real y contenido cargado.

- Texto a Voz (TTS) con Múltiples Voces: Transforma texto en habla realista.

- Detección Automática de Idioma: Admite la detección de varios idiomas sin selección específica.

- Identificación de Hablantes: Separa las voces entre los hablantes en la conversación.

- Detección de Palabras Clave: Recoge palabras o frases específicas de la entrada de voz.

- Baja Latencia: Diseñado para aplicaciones interactivas de baja latencia.

7. Mozilla DeepSpeech

Mozilla DeepSpeech es un motor de voz a texto (STT) de código abierto, de extremo a extremo, basado en la investigación de Baidu Deep Speech. Puede ser entrenado desde cero, lo que permite modelos personalizados y un ajuste fino sobre conjuntos de datos particulares. Es una excelente opción para aquellos que buscan un control total sobre el modelo de reconocimiento de voz y desean la capacidad de ejecutarlo completamente offline y en hardware con recursos limitados.

- Modelo Inglés Pre-entrenado: Incluye un modelo de transcripción en inglés de alta precisión.

- Aprendizaje por Transferencia: Se puede utilizar para otros idiomas o conjuntos de datos personalizados.

- Soporte Multi-idioma: Incluye wrappers para Python, Java, JavaScript, C y .NET.

- Se Ejecuta en Dispositivos Incrustados: Compilable para ejecutarse en hardware con recursos limitados como Raspberry Pi.

- Personalizable y de Código Abierto: La arquitectura subyacente puede ser modificada por los desarrolladores para satisfacer sus requisitos.

8. Pipecat

Pipecat es una plataforma Python de código abierto que ayuda a simplificar el desarrollo de agentes conversacionales multimodales y de voz primero. Facilita la orquestación de servicios de IA, transporte de red y procesamiento de audio para que los desarrolladores puedan concentrarse en construir experiencias de usuario interactivas e inteligentes.

- Diseño 'Voice-First': Diseñado para la interacción de voz en tiempo real.

- Integración Flexible de IA: Compatible con diferentes proveedores de STT, TTS y LLM.

- Arquitectura de Pipeline: Facilita el diseño modular y basado en componentes reutilizables.

- Procesamiento en Tiempo Real: Admite interacciones de baja latencia con integración de WebRTC y WebSocket.

- Listo para Producción: Construido para implementaciones a nivel empresarial.

9. PyAudio

PyAudio es un paquete de Python que incluye enlaces a la biblioteca PortAudio, lo que permite el acceso y control de dispositivos de audio para micrófonos y altavoces. Es una herramienta clave para el desarrollo de agentes de voz que permite la grabación y reproducción de audio en Python. Aunque no es una biblioteca de reconocimiento de voz en sí misma, es fundamental para cualquier aplicación de voz que necesite interactuar con hardware de audio.

- Entrada y Salida de Audio: Permite que las aplicaciones capturen audio de micrófonos y emitan audio a los altavoces.

- Soporte Multiplataforma: Se ejecuta en Windows, macOS y Linux.

- Acceso de Bajo Nivel al Hardware: Ofrece acceso granular a los flujos de audio.

10. Pocketsphinx (CMUSphinx)

Pocketsphinx es un motor de reconocimiento de voz ligero y de código abierto diseñado para funcionar completamente offline. Forma parte del proyecto CMU Sphinx y es adecuado para aquellas aplicaciones que necesitan reconocer voz sin conexión a internet, lo que lo convierte en un candidato ideal para entornos con recursos y privacidad limitados. Esta biblioteca es la respuesta directa a tu pregunta sobre CMUSphinx, ofreciendo una solución robusta y gratuita para tu aplicación comercial.

- Reconocimiento de Voz Offline: Se ejecuta sin conexión a internet.

- Reconocimiento Continuo de Voz: Es capaz de reconocer voz continua en lugar de palabras individuales.

- Detección de Palabras Clave: Reconoce palabras o frases particulares de la entrada de audio.

- Modelos Acústicos y de Lenguaje Personalizados: Permite personalizar los modelos de reconocimiento.

- Integración con Python: Ofrece una interfaz Python para una integración perfecta.

Tabla Comparativa de Bibliotecas Clave para Agentes de Voz

Para facilitar tu elección, aquí tienes una tabla que resume las características más importantes de algunas de las bibliotecas mencionadas, con un enfoque en su aplicabilidad para proyectos comerciales y la facilidad de uso para principiantes en Python.

| Biblioteca | Tipo (STT/TTS/Framework) | Conectividad (Online/Offline) | Licencia (Comercial) | Complejidad (Principiante) | Funcionalidades Clave |

|---|---|---|---|---|---|

| Google Speech API (referencia) | STT, TTS | Online | Pago (con nivel gratuito limitado) | Media | Alta precisión, multilingüe |

| SpeechRecognition | STT | Online/Offline (múltiples motores) | Código Abierto (MIT) | Baja | Interfaz unificada para varios motores, calibración de ruido |

| Pyttsx3 | TTS | Offline | Código Abierto (LGPL) | Baja | Síntesis de voz local, control de velocidad/volumen |

| Vocode | Framework (STT, TTS, LLM) | Online/Offline (depende de integraciones) | Código Abierto (MIT) | Media | Asistentes de voz en tiempo real basados en LLM |

| WhisperX | STT | Offline (modelos descargables) | Código Abierto (MIT) | Media-Alta | Transcripción rápida, diarización, marcas de tiempo precisas |

| Rasa | Framework (NLU, Diálogo) | Offline (modelos entrenados localmente) | Código Abierto (Apache 2.0) | Media-Alta | Gestión de diálogos compleja, NLU avanzado |

| Mozilla DeepSpeech | STT | Offline | Código Abierto (Mozilla Public License 2.0) | Media-Alta | Entrenable, ejecuta en dispositivos embebidos |

| Pocketsphinx | STT | Offline | Código Abierto (BSD) | Media | Ligero, reconocimiento continuo, detección de palabras clave |

Aplicaciones de los Agentes de Voz en el Mundo Real

Los agentes de voz se utilizan en numerosas aplicaciones del mundo real en diversas industrias. Algunos ejemplos son:

- Asistentes Controlados por Voz (ej., Amazon Alexa, Google Assistant): Los agentes de voz ayudan a gestionar diversos electrodomésticos inteligentes, como luces, termostatos y sistemas de entretenimiento, utilizando comandos de voz.

- Automatización del Hogar: Permiten a los usuarios automatizar hábitos domésticos como configurar alarmas u organizar listas de compras y muchos más.

- Telemedicina y Monitoreo de Salud: Los asistentes de voz también pueden ayudar a los pacientes con auto-chequeos de salud simples, recordarles que tomen sus medicamentos o hacer citas con médicos.

- Asistentes de Salud Virtuales: Plataformas como IBM Watson emplean agentes de voz para apoyar a los médicos proporcionando datos médicos, haciendo recomendaciones de diagnóstico y procesando pacientes.

- Asistentes de Voz en el Automóvil: Los vehículos con agentes de voz incorporados (ej., Tesla, BMW) permiten a los conductores navegar, cambiar la música o responder llamadas, todo sin usar las manos. Algunas plataformas también ofrecen características relacionadas con la seguridad, como notificaciones de tráfico en tiempo real.

- Servicios de Viajes Compartidos: Servicios como Uber o Lyft han añadido comandos de voz para permitir a los usuarios reservar viajes o consultar el estado del viaje a través de comandos de voz.

Conclusión

Los agentes de voz han revolucionado la interacción humano-máquina, creando interfaces conversacionales fluidas e inteligentes. Ahora se utilizan en aplicaciones que van más allá de los dispositivos domésticos inteligentes, beneficiando a industrias desde la atención al cliente hasta la atención médica. Poderosas bibliotecas como Vocode, WhisperX, Rasa y Deepgram, junto con soluciones offline como Pocketsphinx y Mozilla DeepSpeech, impulsan esta innovación y permiten el reconocimiento de voz, la conversión de texto a voz y el procesamiento del lenguaje natural. Estas bibliotecas desglosan procesos complejos de IA, haciendo que los agentes de voz sean más inteligentes, más receptivos y más escalables.

Con el continuo desarrollo de la IA, los agentes de voz serán cada vez más avanzados, amplificando la automatización y la accesibilidad en la vida diaria. Con los avances en la tecnología de voz y las contribuciones de código abierto, estos agentes seguirán siendo una piedra angular de los ecosistemas digitales contemporáneos, permitiendo la eficiencia y mejorando las interfaces de usuario. Para un principiante en Python que busca desarrollar una aplicación comercial con requerimientos de bajo costo o uso offline, Pocketsphinx se destaca como una excelente opción por su naturaleza independiente de la conexión y su licencia de código abierto, mientras que SpeechRecognition ofrece una gran flexibilidad al permitirte alternar entre motores online y offline.

Ya sea que estés construyendo un asistente de voz simple o un sistema sofisticado basado en IA, estas bibliotecas ofrecen características básicas para facilitar tu proceso de desarrollo. ¡Así que anímate y pruébalas en tu próximo proyecto!

Preguntas Frecuentes

P1. ¿Qué es un agente de voz?

R. Un agente de voz es un sistema impulsado por IA que interactúa con los usuarios a través del lenguaje hablado, utilizando reconocimiento de voz, texto a voz y procesamiento del lenguaje natural.

P2. ¿Cómo funcionan los agentes de voz?

R. Los agentes de voz convierten la entrada hablada en texto utilizando tecnología de voz a texto (STT), la procesan utilizando modelos de IA y responden mediante texto a voz (TTS) o audio pregrabado.

P3. ¿Qué bibliotecas se utilizan comúnmente para construir agentes de voz?

R. Las bibliotecas populares incluyen Vocode, WhisperX, Rasa, Deepgram, PyAudio y Mozilla DeepSpeech para el reconocimiento de voz, la síntesis y el procesamiento del lenguaje natural. Pocketsphinx es una excelente opción offline.

P4. ¿Qué tan precisos son los agentes de voz impulsados por IA?

R. La precisión depende de la calidad del modelo STT, el ruido de fondo y la pronunciación del usuario. Los modelos avanzados como WhisperX y Deepgram proporcionan alta precisión.

P5. ¿Pueden los agentes de voz manejar múltiples idiomas?

R. Sí, muchos agentes de voz modernos admiten capacidades multilingües, y algunas bibliotecas ofrecen modelos específicos de idioma para una mayor precisión.

P6. ¿Cuáles son los mayores desafíos en el desarrollo de agentes de voz?

R. Los desafíos incluyen errores de reconocimiento de voz, entornos ruidosos, manejo de diversos acentos, latencia en las respuestas y garantía de la privacidad del usuario.

P7. ¿Son seguros los agentes de voz para manejar datos sensibles?

R. La seguridad depende del cifrado, las políticas de manejo de datos y si el procesamiento se realiza localmente o en la nube. Las soluciones centradas en la privacidad utilizan el procesamiento en el dispositivo (offline).

Si quieres conocer otros artículos parecidos a Explorando Alternativas Gratuitas para Agentes de Voz puedes visitar la categoría Librerías.